Che cos’è l’ecosistema dell’intelligenza artificiale?

L’ecosistema dell’intelligenza artificiale è l’insieme coordinato di modelli linguistici (LLM), infrastrutture hardware, database vettoriali e interfacce applicative che permettono alle macchine di interagire e risolvere problemi complessi.

Comprendere l’ecosistema dell’intelligenza artificiale oggi significa distinguere tra modelli chiusi e aperti, saper gestire i dati tramite sistemi RAG e integrare agenti autonomi per scalare la produttività aziendale nel 2026.

In questa guida vedremo:

-

Ecosistema dell’intelligenza artificiale: la differenza cruciale tra modelli chiusi (Proprietari) e modelli Open Weights.

-

Interazione e gestione: come far girare l’ecosistema dell’intelligenza artificiale in locale con Ollama e LM Studio.

-

Le tre facce dell’automazione: Chatbot, LLM Call e la potenza degli Agenti AI nell’ecosistema dell’intelligenza artificiale.

-

Architetture avanzate: RAG, Database Vettoriali e sistemi Multi-Agente per costruire sopra l’ecosistema dell’intelligenza artificiale.

-

Percorsi di implementazione: scegliere tra soluzioni No-Code, sviluppo puro o servizi “chiavi in mano” nell’ecosistema dell’intelligenza artificiale.

L’obiettivo è mappare l’intero ecosistema dell’intelligenza artificiale

L’esplosione tecnologica degli ultimi anni ha generato una confusione senza precedenti. Ogni giorno veniamo bombardati da nuovi termini: Ollama, RAG, agenti AI, modelli LLM, Claude Code, Vector DB.

Per chi cerca di capire come integrare queste tecnologie nel proprio lavoro o nella propria azienda, il rischio di perdersi tra decine di loghi e software è altissimo.

Questa guida nasce con l’obiettivo di mappare l’intero ecosistema dell’intelligenza artificiale, offrendo una bussola chiara sia per i programmatori esperti che per i semplici curiosi.

Che tu voglia imparare a sviluppare le tue soluzioni, utilizzare strumenti pronti all’uso o decidere di pagare per servizi professionali, comprendere la struttura di questo mondo è il primo passo fondamentale per non sprecare risorse in strumenti inutili.

1. Il Cuore dell’Ecosistema dell’Intelligenza Artificiale: I Modelli LLM

Tutto comincia dai modelli LLM (Large Language Models), i “motori” che permettono alle macchine di comprendere e generare linguaggio. Nell’attuale ecosistema dell’intelligenza artificiale, possiamo dividere questi modelli in due grandi categorie fondamentali:

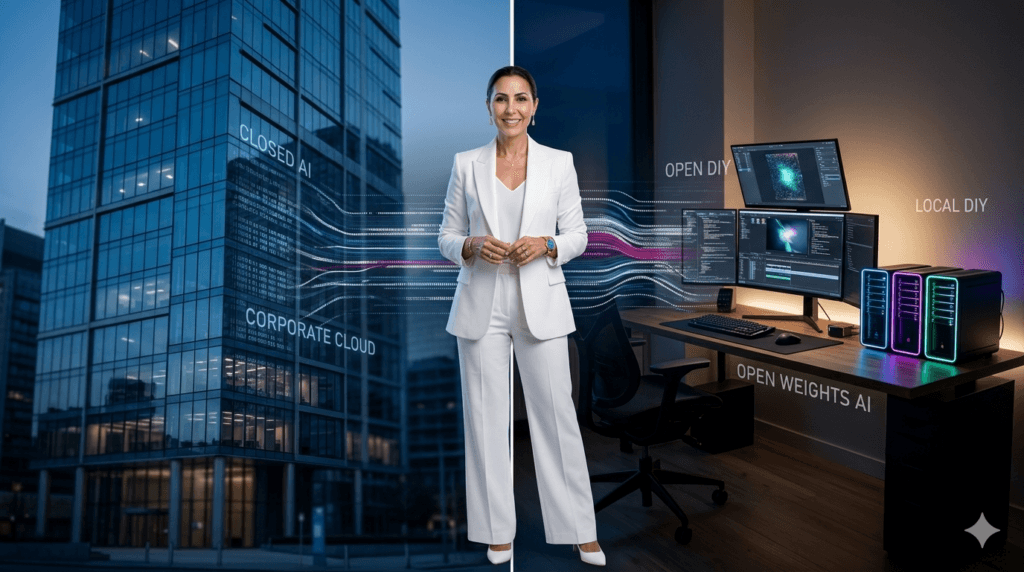

Modelli Chiusi (Proprietari)

Sono i modelli più famosi e potenti, sviluppati da grandi aziende che ne mantengono il codice segreto. In genere, si accede a questi servizi tramite abbonamento o pagamento a consumo.

- Esempi: ChatGPT (OpenAI), Claude (Anthropic), Gemini (Google), Grok (xAI) e Copilot (Microsoft).

- Vantaggi: Alte performance, facilità d’uso estrema tramite siti web e supporto costante.

Modelli Open Weights (Aperti)

A differenza dei primi, questi modelli sono pubblici. Chiunque può scaricarli e utilizzarli liberamente sul proprio computer o server, spesso senza pagare un centesimo per l’utilizzo del modello stesso.

- Esempi: Llama (Meta), Gemma (Google), Qwen (Alibaba) e DeepSeek.

- Vantaggi: Privacy totale (i dati non escono dal tuo computer), costo zero per il modello e possibilità di personalizzazione estrema.

Spesso le aziende giocano su entrambi i fronti: ad esempio, Gemma è la versione “open” di Gemini, così come Llama rappresenta la versione gratuita e aperta della tecnologia di Meta AI.

Scegliere il motore giusto nell’ecosistema dell’intelligenza artificiale è come scegliere le fondamenta di una casa: un errore iniziale può compromettere la scalabilità futura.

2. Come Interagire con l’Ecosistema: Dalle Interfacce Web al Locale

Una volta scelto il modello, come lo utilizziamo concretamente?

L’ecosistema dell’intelligenza artificiale offre diverse modalità di interazione, a seconda del livello di competenza tecnica e delle necessità di business.

Utilizzo dei Modelli Chiusi

Per i modelli a pagamento, la via più semplice è il sito web ufficiale (come chatgpt.com).

Tuttavia, i professionisti e le aziende utilizzano spesso le API, che permettono di integrare l’intelligenza artificiale direttamente all’interno di altri software o flussi di lavoro aziendali senza dover scrivere manualmente ogni prompt in una chat.

Utilizzo dei Modelli Open (In Locale o su Server)

Se scegli la via dell’AI “fai-da-te” o gratuita, devi far girare il modello su una macchina. Puoi farlo in locale sul tuo computer (se hai abbastanza RAM) o affittando uno spazio server online. In questo secondo caso, pagherai solo il costo del server, non l’abbonamento all’AI.

Per gestire questi modelli in modo semplice, sono nati software diventati standard nell’ecosistema dell’intelligenza artificiale:

- Ollama: Uno dei loghi più riconosciuti, permette di scaricare e gestire modelli con pochi comandi.

- LM Studio e GPT4All: Interfacce grafiche che ti permettono di usare l’AI sul tuo PC con un’esperienza simile a ChatGPT, ma in totale privacy.

3. Chatbot, LLM Call e Agenti AI: Le Tre Facce dell’Interazione

Capire come l’AI “lavora” è essenziale per orientarsi nell’ecosistema dell’intelligenza artificiale. Non tutto è una semplice chat.

- LLM Call (Chiamata al Modello): È un’operazione invisibile all’utente. Un software riceve un dato (es. un’email), interroga l’AI in background per sapere se è spam e agisce di conseguenza. Non c’è interazione umana diretta.

- Chatbot: È il classico sistema domanda-risposta. Tu scrivi, l’AI risponde (eventualmente cercando documenti tramite RAG) e l’interazione si conclude lì.

- Agenti AI: La vera frontiera dell’automazione. Un agente non si limita a rispondere, ma lavora in un loop autonomo finché non completa un compito complesso (es. “organizza tutti i file in questa cartella e crea un report”).

L’agente analizza, agisce, verifica il risultato e continua finché il task non è finito, proprio come farebbe un collaboratore umano adulto e indipendente.

4. Costruire sopra i Modelli: RAG, Database Vettoriali e Multi-Agenti

L’ecosistema dell’intelligenza artificiale permette a chiunque di costruire applicazioni personalizzate. Non serve solo un modello “puro”, ma un’architettura che lo supporti.

- RAG (Retrieval-Augmented Generation): È un sistema che permette all’AI di consultare i tuoi documenti privati (PDF, database, file Excel) per dare risposte precise basate sui tuoi dati aziendali, evitando “allucinazioni”.

- Embedding Models e Vector DB: Sono le tecnologie tecniche dietro il RAG. Servono a trasformare i documenti in “numeri” (vettori) che l’AI può comprendere e ricercare velocemente.

- Sistemi Multi-Agente: Gruppi di agenti AI che collaborano tra loro, ognuno con un compito specifico, per risolvere problemi complessi di scala aziendale.

5. Strumenti per Tutti: Sviluppare, Imparare o Comprare?

La bellezza dell’attuale ecosistema dell’intelligenza artificiale è la sua accessibilità. Esistono percorsi diversi per ogni profilo:

Percorso Low-Code/No-Code (Per curiosi e business owner)

Non devi essere un programmatore per creare la tua AI. Strumenti come Dify o Flowise permettono di costruire sistemi complessi di agenti e RAG tramite interfacce visive, trascinando blocchi sullo schermo. È l’ideale per chi vuole imparare velocemente o prototipare soluzioni interne.

Percorso Code (Per sviluppatori)

Se sei un programmatore, puoi utilizzare framework potenti come LangChain, CrewAI o LlamaIndex per costruire applicazioni AI scalabili e personalizzate.

L’integrazione è facilitata da standard come il Protocollo MCP (Model Context Protocol) di Anthropic, che funge da ponte tra l’AI e i software aziendali come Excel o database SQL.

Percorso “Servizio Chiavi in Mano” (Per le aziende)

Molte aziende preferiscono non gestire la complessità tecnica ma ottenere i risultati. In questo caso, si paga per l’implementazione di soluzioni personalizzate che integrano l’AI nei processi esistenti, garantendo sicurezza, efficienza e ritorno sull’investimento.

Domande Frequenti sull’Ecosistema dell’Intelligenza Artificiale (FAQ)

1. Qual è il modo più economico per testare l’ecosistema dell’intelligenza artificiale?

Il modo più accessibile è iniziare con i modelli “Open Weights” come Llama o Gemma.

Scaricando software gratuiti come Ollama o LM Studio, puoi far girare l’ecosistema dell’intelligenza artificiale direttamente sul tuo computer senza costi di abbonamento mensili, sfruttando solo la potenza del tuo hardware.

2. I dati della mia azienda sono al sicuro in questo ecosistema?

Dipende dalla modalità di interazione scelta. Se utilizzi interfacce web di modelli chiusi, i dati passano attraverso i server del fornitore.

Se invece implementi un ecosistema dell’intelligenza artificiale in locale, i documenti restano confinati nel tuo perimetro aziendale, garantendo una privacy totale e il controllo assoluto sulle informazioni sensibili.

3. Quanto tempo ci vuole per integrare un ecosistema dell’intelligenza artificiale professionale?

Grazie alle piattaforme No-Code e Low-Code come Dify, è possibile prototipare una prima soluzione basata su agenti e RAG in pochi giorni.

Tuttavia, per un’integrazione completa dell’ecosistema dell’intelligenza artificiale nei flussi di lavoro aziendali più complessi, è consigliabile un approccio strutturato che può richiedere alcune settimane di test e raffinamento dei prompt.

La Tua Mappa nell’Ecosistema dell’Intelligenza Artificiale

L’ecosistema dell’intelligenza artificiale non deve spaventare. Che si tratti di loghi nuovi o di termini tecnici, quasi tutto può essere ricondotto a: un modello (aperto o chiuso), un modo per farlo girare (cloud o locale) e un modo per utilizzarlo (chat, chiamata o agente).

Non è necessario avere “le mani in pasta ovunque”. Il segreto è conoscere l’ecosistema, capire cosa serve realmente alla tua specifica realtà, testare alcuni software e scartare il resto. L’intelligenza artificiale è uno strumento al tuo servizio, non un labirinto in cui restare prigionieri.

L’importanza di un Ecosistema dell’Intelligenza Artificiale Integrato

Non basta scegliere un singolo software per dire di aver adottato l’IA; il vero vantaggio competitivo nasce dalla capacità di orchestrare l’intero ecosistema dell’intelligenza artificiale all’interno dei processi aziendali. Spesso le imprese commettono l’errore di isolare gli strumenti, creando “silos” tecnologici che non comunicano tra loro. In un ecosistema dell’intelligenza artificiale moderno, invece, i dati devono fluire liberamente tra il modello linguistico (LLM), i database vettoriali e le automazioni finali.

Perché monitorare l’evoluzione dell’Ecosistema?

L’ecosistema dell’intelligenza artificiale cambia a una velocità mai vista prima. Quello che oggi è uno standard, come l’uso di semplici chatbot, domani potrebbe essere superato da agenti autonomi capaci di prendere decisioni complesse senza supervisione umana costante. Restare aggiornati sulle novità dell’ecosistema dell’intelligenza artificiale permette di:

-

Ridurre i costi operativi: sapendo quando usare un modello aperto (Open Weights) invece di uno a pagamento.

-

Garantire la privacy dei dati: sfruttando le soluzioni locali dell’ecosistema dell’intelligenza artificiale come Ollama.

-

Migliorare la precisione: utilizzando architetture RAG per alimentare l’ecosistema dell’intelligenza artificiale con i propri documenti aziendali.

Vuoi capire come trasformare l’Ecosistema dell’Intelligenza Artificiale in un vantaggio competitivo per la tua azienda?

Non lasciare che la complessità ti blocchi. Esistono soluzioni su misura che possono automatizzare i tuoi processi, migliorare l’assistenza clienti e ottimizzare la gestione dei dati.

Prenota ora una consulenza gratuita per analizzare le tue esigenze e scoprire cosa posso fare concretamente per far fare il salto di qualità al tuo business.

L’integrazione consapevole dell’ecosistema dell’intelligenza artificiale non è più un lusso tecnologico, ma la barriera difensiva che proteggerà il tuo business dall’irrilevanza digitale.

Deixe um comentário